Carta al CEO

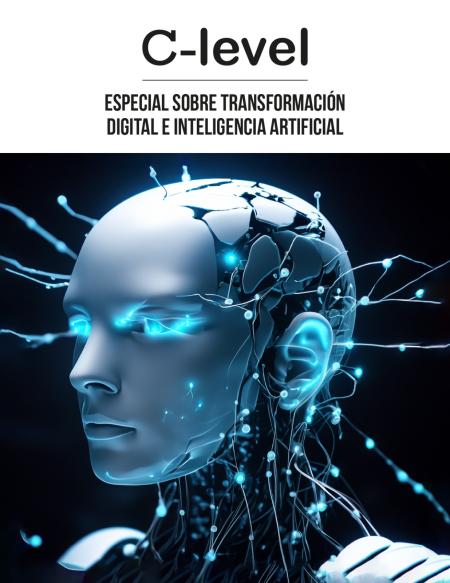

Inteligencia artificial y humana: ¿Amor vs descontrol?

La revolución tecnológica, cuando sale bien, es desmedida y está gloriosamente fuera del amor y el control.

Martes, Abril 18, 2023

Por: Pablo Morales Mosquera; editor Revista C-Level.

Tengo el cuerpo hackeado por la euforia que despierta en mí la ráfaga intempestiva de los desmedidos avances en materia de inteligencia artificial (IA). La velocidad de la tecnología asusta. Que se exagere con ella, conlleva a que aclamemos por su fiscalización.

Las capas de abstracción progresiva de la IA se parecen al cerebro humano, no entendemos cómo funciona. Por eso mismo, insisto, el enorme potencial de la automatización trae consigo riesgos que debemos mitigar con previsión y regulación.

Modelos de lenguaje como el de ChatGPT, basado en el aprendizaje automático y redes neuronales profundas, ha puesto la IA en la palestra pública y el debate cotidiano. Pero éste es apenas el inicio de una nueva era; de aquel paradigma casi que cuántico, que en repetidas ocasiones hemos llamado de manera desprevenida, “futuro”.

Falta poco tiempo para que estos sistemas, cada vez más avanzados, se conviertan en los asistentes constantes e invisibles de nuestras actividades sociales y profesionales, de la vida; los interfaces de nuestros dispositivos, vehículos y electrodomésticos, los oráculos de nuestras decisiones, e incluso, los mediadores entre las personas y las instituciones médicas, administrativas, mediáticas o educativas. Por eso, resulta vital que consideremos los riesgos potenciales, para mitigarlos antes de que se conviertan en una realidad unánime e imposible de controlar.

Mi angustia es latente. El más reciente estudio de OpenAI concluyó que habrá trabajos actuales que se verán afectados por la IA, donde se dejará de contratar a personas. Su despliegue afectará a cerca de 80% de los empleos; 10% de la actividad de los mismos será reemplazada, y 19% verá cómo la mitad de sus tareas será sustituida por ésta, si todo sigue como va.

Asunto que me suscita dos dudas irreconciliables en mi cabeza: ¿Amor vs descontrol? ¿Vamos a permitir que la ambición desmedida de aquellos genios creadores de códigos enigmas se desborde y sus propios bots controlen nuestro estilo de vida, relaciones y emociones?

El problema de la IA es que trata de resolver cuestiones sobre la sociedad que deberíamos afrontar de otra forma. De un lado, porque trata de solucionar los problemas que el mundo digital “anterior” había creado, lo cual termina creando más problemáticas irresolubles.

El riesgo está a la vuelta de la esquina. La sospecha de vulnerar la legislación sobre protección de datos ha sido la causa para abrir investigaciones en diversos rincones del planeta, mientras países como Italia han bloqueado el acceso a aplicaciones como ChatGPT.

La IA generativa podría estar nutriéndose tanto de datos privados como de los de facturación de los usuarios y las empresas, incluidas las conversaciones que mantiene cada ciudadano con el sistema para entrenar los algoritmos.

Por esto mismo, tanto EE.UU., como China y distintos Estados europeos, han activado mecanismos para estudiar posibles efectos indeseados. ¿Pero qué pasa con los países en vía de desarrollo?

Y como si con la violación a la privacidad o a la propiedad intelectual no fuera poco, la consistencia discursiva del texto generado artificialmente, puede bastar para transmitir como veraz lo que solo es verosímil o meramente coherente.

En infinidad de asuntos humanos no existe verdad alguna de referencia, no la hay sobre el aborto, consumo de drogas, desigualdad, sexualidad o el “amor”. La capacidad de afinar respuestas que resultan convincentes y persuasivas para el lector , de acuerdo con su propia expectativa de respuesta entrenada por el algoritmo, forma también parte del problema, porque no hay una salida única para la mayoría de las preguntas que nos formulamos los seres humanos.

En un campo tan humano como lo es el de la educación, la problemática no es que los estudiantes tengan más herramientas para copiar, sino que la educación no disponga de un modelo de enseñanza y aprendizaje que dé cabida a la adquisición de capacidades analíticas y sintéticas sobre el dominio de la información. ¿Vamos a permitir que la robótica se apropie también del poder analítico y la capacidad de discernir de las futuras generaciones?

Siendo así la cosa…¿No sería más inteligente entonces, repensar la estrategia y crear herramientas para modelar futuros que nos gustaría vivir, con conocimiento sobre experiencias realmente humanas que han tenido éxito en el pasado, en lugar de algo así como automatizar el calentamiento global mientras elevamos dudas a un bot?

Nota: Esta posición editorial no fue construida bajo el control de herramientas de IA.